一、人形機器人的“能力困境”:從僵硬到靈巧的鴻溝

人形機器人雖能奔跑踢球����、工業(yè)分揀搬運���、甚至完成半程馬拉松���,但其核心能力仍高度依賴工程師的精細化訓練。對人類而言本能的抓取��、避障�、力度控制等操作,對機器人卻是需反復學習的復雜技能:

1.動作精度缺陷:早期機器人抓取水果時常因釋放高度誤差導致砸損�,工業(yè)場景中更因速度滯后影響產(chǎn)線節(jié)奏���;

2.環(huán)境適應性弱:同一動作在光照變化或設備位移時可能失效�,需針對場景重建感知模型���;

3.跨任務遷移難:會行走的機器人無法自動學會搬運�,每項新技能需獨立訓練。

4.工程師的示教,正是填補這一鴻溝的橋梁�。通過設計軌跡動作�、調(diào)試力控參數(shù)�����、標注視覺數(shù)據(jù)��,他們將人類經(jīng)驗轉(zhuǎn)化為機器可理解的數(shù)字指令。

二、富唯智能的“示教引擎”:如何讓工程師事半功倍

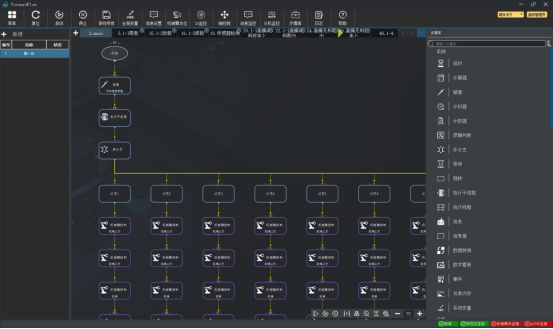

富唯智能的機器人技術架構�,將工程師示教效率提升至新高度���。其核心突破在于構建閉環(huán)訓練系統(tǒng)�����,打通“示教-學習-驗證”全鏈路:

1. 模塊化實訓平臺:降低示教門檻

集成六維力傳感器與3D視覺系統(tǒng),實時捕捉力度與位姿數(shù)據(jù)����;

開源上位機軟件支持圖形化編程����,工程師通過拖拽即可設計動作鏈����,無需代碼基礎�����;

動態(tài)碰撞檢測與軌跡仿真功能�,避免真實場景中的試錯損耗�����。

2. 多模態(tài)數(shù)據(jù)驅(qū)動學習

工程師示教過程產(chǎn)生的軌跡數(shù)據(jù)���、力反饋�、點云信息被系統(tǒng)自動采集�����,用于訓練自適應模型:

3D視覺模塊實現(xiàn)±0.1mm級點云配準���,使機器人識別異形工件如手機殼曲面���;

力控裝配參數(shù)經(jīng)20次迭代后����,抓取TPU軟殼的良品率從82%升至99.8%�����。

3. 跨場景技能遷移架構

基于ForwardControl智能控制系統(tǒng),示教成果可快速復用:

在手機殼加工線訓練的抓取策略,經(jīng)參數(shù)微調(diào)即可應用于汽車零部件搬運;

支持50種夾具的模塊化接口����,工程師5分鐘切換末端執(zhí)行器適配新任務�����。

三��、從實驗室到產(chǎn)線:示教如何成就機器人“進化”

在東莞某電子廠的實戰(zhàn)驗證了工程師示教的價值:

1.初期(1-2周):工程師針對亞克力材質(zhì)調(diào)試抓取力度,通過300次示教解決劃傷問題��;

2.中期(3-4周):導入動態(tài)料框識別算法�,使機器人適應無序堆疊的原料箱;

3.成熟期:雙臂協(xié)同裝配節(jié)拍縮短至18秒�,夜間產(chǎn)能提升40%且零人工干預����。

示教工程師的屏幕前��,機器人正在學習新技能——3D視覺引導下����,機械臂以0.2毫米誤差將金絲鑲?cè)胧謾C殼凹槽�。

“每個動作需經(jīng)歷上百次迭代,”工程師指著曲線圖解釋�,“但一旦‘畢業(yè)’�,它將成為永不疲倦的標準化專家�。”

四�、未來方向:當示教遇上具身智能

隨著ARCap等增強現(xiàn)實示教系統(tǒng)興起��,工程師可通過AR眼鏡直觀規(guī)劃虛擬機器人動作,系統(tǒng)自動生成控制代碼。富唯智能正研發(fā)融合AR反饋的示教平臺,實現(xiàn):

1.實時碰撞預警:觸覺振動提示關節(jié)限位風險;

2.跨形態(tài)重定向:同一示教數(shù)據(jù)適配多款機器人硬件��;

3.AI輔助優(yōu)化:深度學習自動推薦抓取路徑與力度參數(shù)�。

示教不是對機器的妥協(xié),而是對人機協(xié)同的深度賦能。正如訓練師吳廣所言:“要把機器人當作伙伴”——工程師輸入的不僅是數(shù)據(jù)��,更是讓機器理解物理世界的“感官語言”�。在富唯智能技術框架下,每一次示教都在推動機器人突破能力邊界,讓“人形”真正邁向“人性”��。